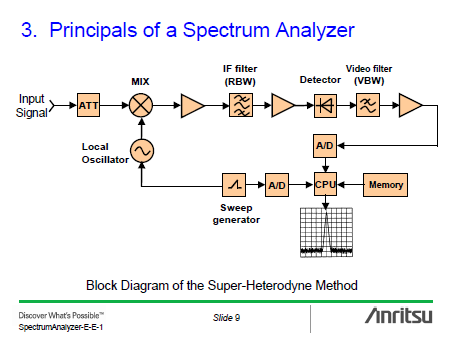

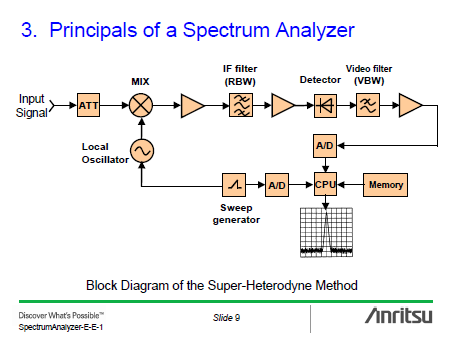

Ecco, diciamo che gli analizzatori di spettro sono sistemi molto complessi. Su un segnale "forte" inserisce un'attenuatore per mantenerlo nel range di maggiore linearità, ma poi non riamplifica di quanto è stato attenuato perchè il risultato sarebbe solo un deterioramento del c/n se non una saturazione verso gli stadi successivi.

Facciamo un esempio:

Dobbiamo misurare un segnale di 95dBuV e lo strumento inserisce un'attenuatore di 30dB per tenerlo entro i 70dBuV (95-30=65) che ipotizziamo sia il valore massimo che accetta il convertitore A/D.

Gli stadi di conversione e di filtraggio che precedono il convertitore non possono introdurre 30dB di guadagno, tanto quanto è l'attenuazione, perchè il livello tornerebbe a 95dBuV (65+30=95) e sarebbe fuori scala al convertitore (max 70).

Quello che invece fa lo strumento è di conteggiare l'attenuazione calibrata in ingresso aggiungendola al valore misurato dopo la conversione per avere una lettura a display della reale intensità del segnale all'ingresso.

Il funzionamento nel dettaglio potrà variare da strumento a strumento ma in linea di principio è così che funziona.